PHOTO

Da tempo circolano in rete immagini choc sul massacro dei palestinesi di Gaza interamente generate dall’intelligenza artificiale. In larga parte riguardano bambini, in un contrasto vivido quanto posticcio tra innocenza e orrore: li vedi sepolti sotto le macerie, piangenti di fronte ai paesaggi lunari della Striscia, orrendamente sfigurati dalle bombe dell’Idf.

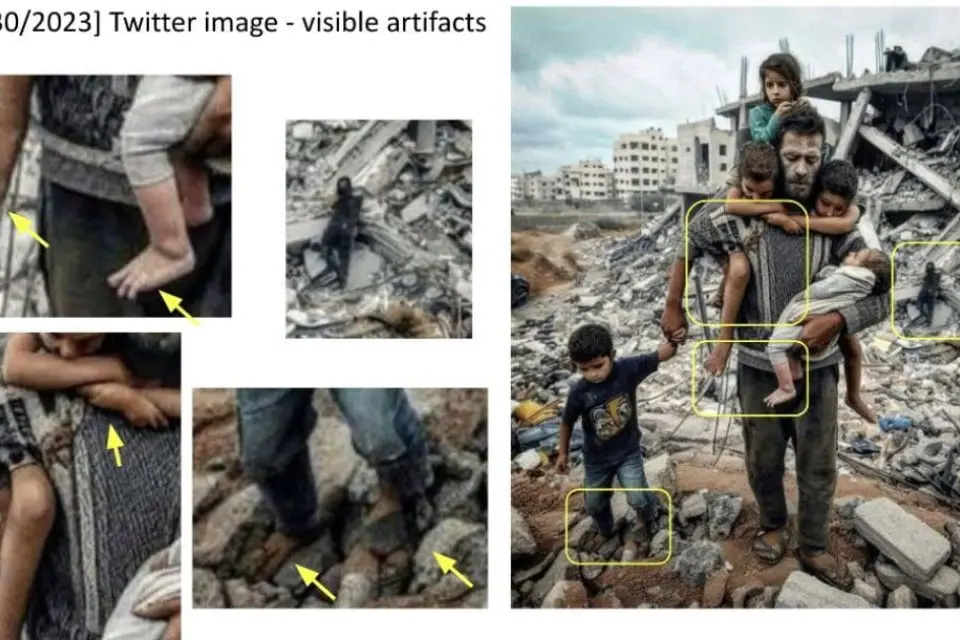

Spesso sono accompagnate da didascalie cariche di indignazione che denunciano «le atrocità», «la vergogna», la «fine dell’umanità». Se un occhio esperto è ancora in grado di capire quando si trova davanti a un “fake”, magari per dei dettagli incongruenti, un’ombra che non coincide con il corpo, una prospettiva sfalsata e così via, con la costante e vertiginosa evoluzione dei software di AI, diventerà sempre più difficile riuscire a distinguere un’immagine vera da una farlocca.

La domanda sorge spontanea: dopo un anno di guerra, oltre 40mila palestinesi uAccisi, infrastrutture e edifici distrutti, tutto documentato da fotografi e operatori di ogni parte del mondo, c’è davvero bisogno di ideare e pubblicare dei falsi?

Qual è la ragione che spinge qualcuno a costruire una rappresentazione fittizia su una tragedia reale? Riesce difficile immaginare qualcosa di più osceno nei confronti delle vittime, uno show del dolore e della commozione che si sovrappone, cancellandolo, al dramma in carne e ossa dei civili di Gaza. E che ci restituisce una crudele istantanea sulla perdita di senso dell’odierna società dell’informazione e sulla sua estetica mitomane della sofferenza. Come diceva Guy Dédord «lo spettacolo non è un insieme di immagini, ma un rapporto sociale fra individui, mediato dalle immagini». Le gallerie tarocche del dramma palestinese che ammorbano il web segnano un passaggio ulteriore in cui i rapporti sociali non hanno neanche più bisogno di immagini reali.